Adorno im Zeitalter der KI: Freiheit oder neue Höhle?

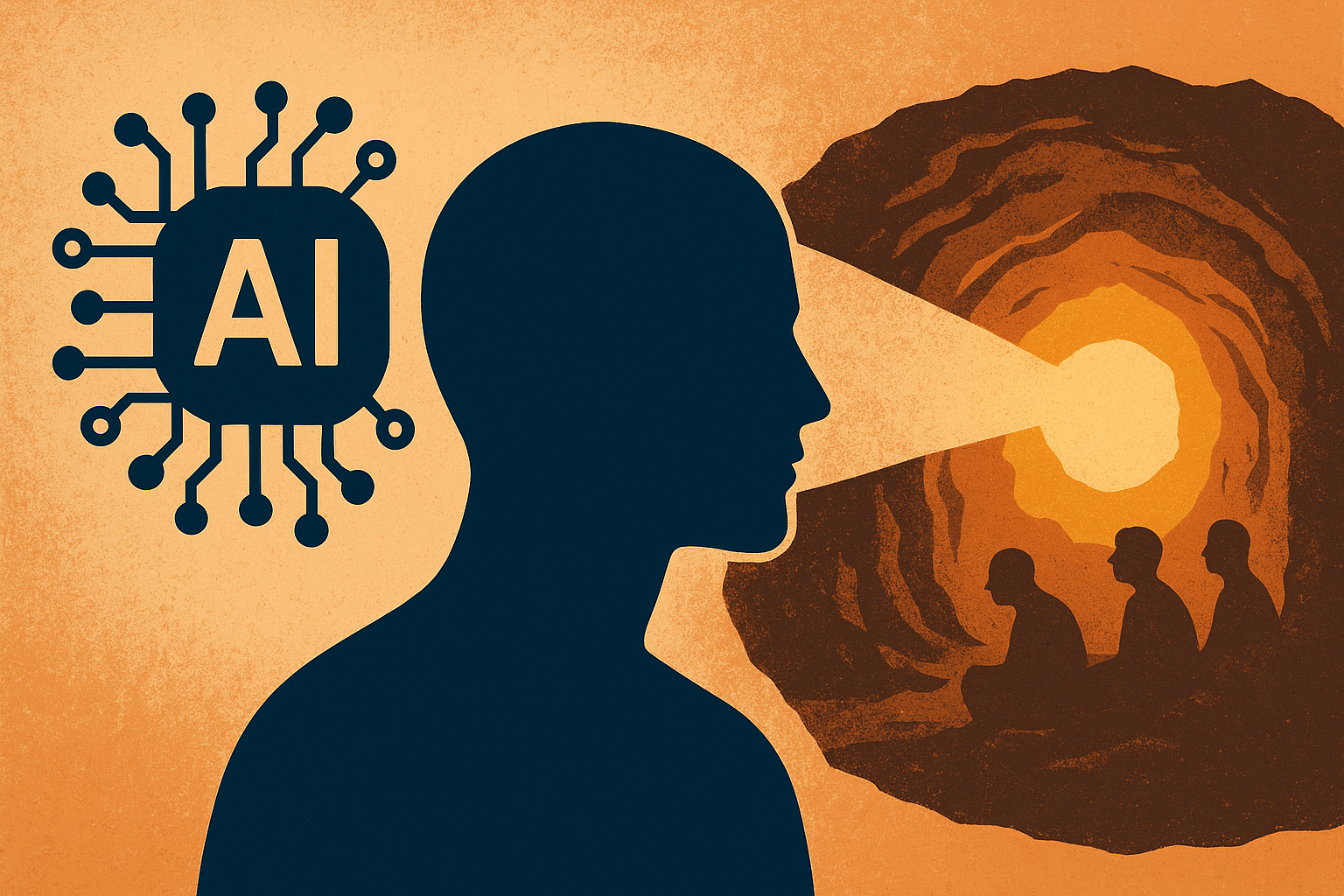

Kürzlich hörte ich einen Podcast zu Adorno und mir kamen beim Zuhören einige Gedanken in Verbindung mit KI. Künstliche Intelligenz eröffnet neue Möglichkeiten, Wissen zu erweitern und Entscheidungen zu erleichtern. Gleichzeitig birgt sie das Risiko, uns in digitale „Höhlen Platons“ zu führen, in denen wir nur Schatten der Realität sehen. Adornos Warnung, dass Aufklärung nicht automatisch Freiheit schafft, ist aktueller denn je. Nur wer KI kritisch hinterfragt, ethische Leitplanken setzt und eigene Denkmuster reflektiert, kann Technologie wirklich als Werkzeug der Freiheit nutzen.

Die Frage, ob wir in Zeiten künstlicher Intelligenz wirklich freier werden, hätte Adorno sofort interessiert. Schon er warnte davor, dass Aufklärung nicht automatisch Befreiung bedeutet, sondern selbst neue Formen von Unfreiheit erzeugen kann. KI verspricht uns heute Effizienz, Wissen und Orientierung – doch zugleich stellt sie die Frage, ob wir nicht neuen Illusionen aufsitzen.

Die Frage, ob wir in Zeiten künstlicher Intelligenz wirklich freier werden, hätte Adorno sofort interessiert. Schon er warnte davor, dass Aufklärung nicht automatisch Befreiung bedeutet, sondern selbst neue Formen von Unfreiheit erzeugen kann. KI verspricht uns heute Effizienz, Wissen und Orientierung – doch zugleich stellt sie die Frage, ob wir nicht neuen Illusionen aufsitzen. So wie Platon von den Schatten in der Höhle sprach und Descartes den Dämon fürchtete, stehen wir heute vor der Versuchung, den Antworten von Maschinen zu glauben, ohne ihre Voraussetzungen kritisch zu prüfen.

Adorno und die Skepsis der Aufklärung

Adorno prägte den Gedanken, dass Aufklärung nicht nur Befreiung bringt, sondern auch eine neue Art von Mythos hervorbringen kann. Was eigentlich dazu dienen sollte, den Menschen zu emanzipieren, kann zur neuen Fessel werden. Wo Rationalität, Nutzen und Effizienz zur einzigen Maßgabe erhoben werden, verliert der Mensch die Fähigkeit, Wirklichkeit in ihrer Vielschichtigkeit zu begreifen. Technik, so Adorno, ist ambivalent: Sie kann das Leben erleichtern, aber auch entmündigen.

Dieser Gedanke lässt sich mühelos auf die heutige Diskussion um KI übertragen. Chatbots, Bildergeneratoren und automatisierte Analysesysteme nehmen uns Arbeit ab, verdichten Informationen und liefern scheinbar eindeutige Antworten. Doch gerade in der Selbstverständlichkeit, mit der wir ihre Ergebnisse konsumieren, steckt die Gefahr: Wir übersehen, dass diese Antworten auf Modellen, Daten und Wahrscheinlichkeiten beruhen – nicht auf einer objektiven Wahrheit.

Platons Höhlengleichnis neu gelesen

Platon zeigt im Höhlengleichnis, wie schwer es ist, sich aus den Fesseln der Täuschung zu lösen. Die Menschen in der Höhle halten die Schatten für die Wirklichkeit, bis einer von ihnen befreit wird und das Licht der Sonne erblickt. Erst dann erkennt er, dass die Schatten bloße Abbilder sind.

Doch hier beginnt die eigentliche Pointe: Wer aus der Höhle tritt, ist keineswegs endgültig sicher. Woher weiß er, dass der neue sichtbare Raum außerhalb der Höhle nicht selbst nur ein Teil einer noch größeren Höhle ist? Auch das vermeintlich Erkannte könnte nur eine weitere Stufe der Illusion sein. Übertragen auf die Gegenwart: Auch wenn wir glauben, durch Digitalisierung oder KI mehr Zugang zur Realität zu haben, könnte es sich um eine neue Form der Illusion handeln. Was wir in sozialen Netzwerken sehen, sind Bilder, Filter und Ausschnitte – die Schatten der heutigen Höhle.

Descartes’ Dämon in der digitalen Welt

Descartes verschärfte diesen Gedanken mit der Vorstellung eines bösen Dämons, der unsere Wahrnehmungen täuschen könnte. Nichts wäre dann sicher: nicht die Welt, nicht der Körper, nicht die Erfahrung. Nur ein Gedanke bliebe unerschütterlich: „Ich denke, also bin ich.“

Doch auch dieser scheinbar feste Anker wird im digitalen Zeitalter herausgefordert. Denn unser Denken selbst kann durch digitale Systeme beeinflusst werden: durch personalisierte Nachrichtenfeeds, durch Suchmaschinen, die uns bestimmte Informationen vorrangig anzeigen, oder durch KI-gestützte Assistenten, die uns Vorschläge machen, bevor wir selbst nachdenken. Das bedeutet nicht, dass unser Denken völlig fremdbestimmt wäre. Aber es bedeutet, dass wir uns bewusst machen müssen, wie stark wir von Algorithmen geprägt werden, wenn wir Entscheidungen treffen.

KI als neue Form der Aufklärung – oder als neue Höhle?

Künstliche Intelligenz verspricht eine neue Stufe der Aufklärung. Nie zuvor konnten wir so schnell auf Informationen zugreifen, so viele Daten analysieren oder so komplexe Fragen beantworten. Doch gerade darin liegt das Risiko, Adornos Skepsis zu übersehen.

Beispiel Organisation: In vielen Behörden oder Unternehmen wird KI eingesetzt, um Prozesse zu optimieren – sei es bei der Bürgerkommunikation, im Ressourcenmanagement oder in der Datenanalyse. Auf den ersten Blick spart das Zeit und schafft Effizienz. Doch zugleich kann ein Tunnelblick entstehen: Entscheidungen folgen dann den Mustern, die die Systeme vorgeben, während alternative Perspektiven ausgeblendet bleiben. Die Organisation glaubt, aufgeklärt zu handeln, sitzt aber faktisch in einer neuen Höhle aus Kennzahlen und Dashboards.

Beispiel Alltag: Auch privat nutzen wir KI, um uns zu orientieren – vom Navigationsgerät bis zum Sprachassistenten. Wir vertrauen den Systemen, manchmal blind. Aber genau dieses Vertrauen kann gefährlich werden. So wie Platons Gefangene die Schatten für die Wirklichkeit hielten, können auch wir KI-Ergebnisse für wahr halten, obwohl sie nur Wahrscheinlichkeiten abbilden.

Soziale Medien als Schattenwelt

Noch deutlicher wird die Analogie bei sozialen Medien. Sie erzeugen eine Realität aus Bildern, Statusmeldungen und Likes. Das, was wir sehen, sind sorgfältig ausgewählte Ausschnitte des Lebens – die „Schatten“ an der Wand der digitalen Höhle. Sie wirken realer als die Realität selbst, weil sie uns ständig umgeben.

Die Gefahr besteht darin, dass wir diese digitale Sphäre für die eigentliche Wirklichkeit halten. Freundschaften, Debatten, politische Stimmungen – all das bildet sich in Social Media ab, aber in verzerrter Form. Der Algorithmus entscheidet, welche Schatten wir sehen. Wir leben nicht in der Welt, sondern in einem Ausschnitt, der uns plausibel vorkommt.

Ethische Orientierung: Wir brauchen ein KI-Ethikgremium

Wir brauchen ein Ethikgremium, das sich mit den Herausforderungen von KI befasst. Schon heute beraten in vielen Ländern Ethikräte die Politik in Fragen von Biomedizin, Datenschutz oder digitaler Grundrechte. Ähnliches ist für KI unverzichtbar: unabhängige Expertengremien, die nicht nur technische, sondern auch gesellschaftliche, kulturelle und philosophische Perspektiven einbringen.

Das Gremium muss zentrale Fragen beantworten, wie etwa:

- Welche Daten dürfen genutzt werden – und welche nicht?

- Wie wird Transparenz sichergestellt?

- Wie lässt sich verhindern, dass Algorithmen Diskriminierungen verstärken?

- Welche Verantwortung tragen Entwickler, Unternehmen und Staaten?

Damit wird deutlich: Aufklärung im digitalen Zeitalter ist keine rein individuelle Aufgabe. Kritisches Denken entsteht im Zusammenspiel von Technikern, Juristen, Philosophen und Bürgern. Nur so entwickelt sich eine neue Form von Mündigkeit, die uns hilft, KI als Werkzeug der Freiheit zu gestalten – und nicht als neue Form der Höhle.

Optimismus aus der Aufklärung

Wenn wir Adorno ernst nehmen, müssen wir anerkennen, dass es keine endgültige Freiheit gibt – nur den fortwährenden Prozess der Reflexion. Doch darin liegt eine Chance. Wer gelernt hat, kritisch zu hinterfragen, ist weniger anfällig für Täuschungen, Illusionen oder digitale Höhlen.

KI zwingt uns geradezu, neue Formen der Aufklärung zu entwickeln – nicht als naive Fortschrittsgläubigkeit, sondern als aufgeklärte Skepsis. Sie lädt uns ein, Perspektiven zu vergleichen, Quellen zu prüfen und Informationen zu hinterfragen. Wir können Systeme nutzen, um Wissen zu erweitern – ohne uns von ihnen blenden zu lassen.

Adorno im Zeitalter der KI zu lesen, bedeutet: Freiheit immer wieder neu zu verhandeln. Platon und Descartes erinnern uns daran, dass wir Illusionen nie ganz entkommen können. Doch wir können lernen, sie zu durchschauen – und darin liegt der Fortschritt.

Vielleicht war es nie so leicht wie heute, Illusionen zu erliegen. Aber auch nie so möglich, sie zu erkennen. KI kann uns verführen – oder sie kann uns schärfen. Indem wir ihre Antworten kritisch prüfen, ethische Leitplanken schaffen und unsere Denkmuster reflektieren, gestalten wir die Technik als Werkzeug der Freiheit. Die Entscheidung liegt bei uns.

Hier der Link zum Philosophischen Radio WDR5 mit Jürgen Wiebicke